AI SEO/GEO i praksis

Schema.org, robots.txt og AI-læsbar struktur

AI ændrer fundamentalt måden, brugere finder og får information på. På morgenmødet satte vi fokus på, hvordan organisationer kan arbejde strategisk med AI SEO/GEO for at sikre, at deres indhold forstås, prioriteres og citeres korrekt af AI-modeller som ChatGPT, Gemini og Claude.

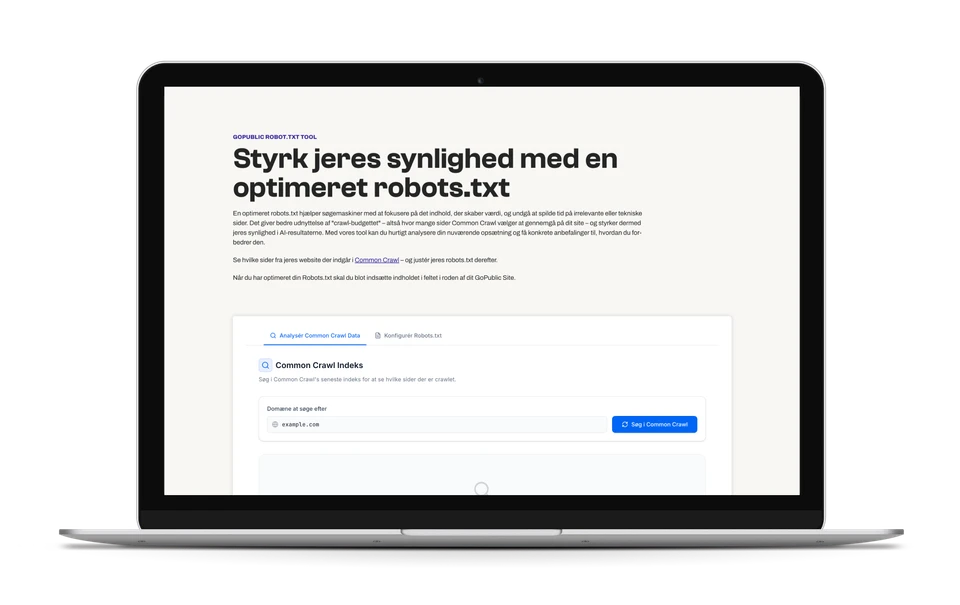

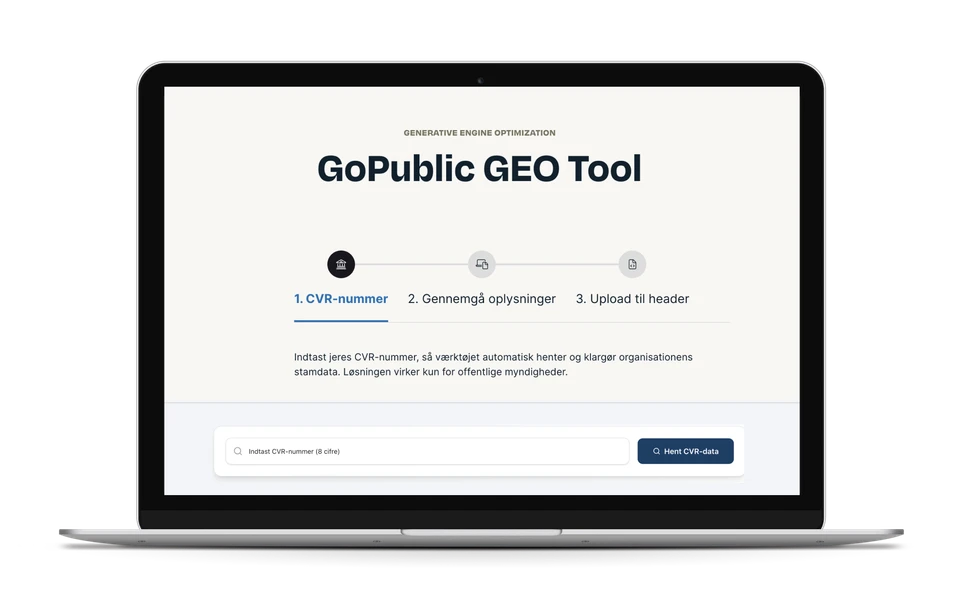

Vi demonstrerede desuden GoPublics GEO-værktøjer til analyse af Common Crawl-data, optimering af robots.txt og generering af Schema.org-markup – med fokus på at gøre websites mere teknisk tilgængelige og maskinlæsbare for AI.